چگونه و چرا از خزیدن ربات ها در سایت شما جلوگیری کنیم

در حالی که میخواهید خزیدن بیشتر محتوا را تا حد امکان برای Google آسان کنید، موارد خاصی وجود دارد که میخواهید رباتها را مسدود کنید.

در بیشتر موارد، ربات ها و عنکبوت ها نسبتاً بی ضرر هستند.

به عنوان مثال، شما می خواهید ربات گوگل وب سایت شما را بخزد و فهرست کند.

با این حال، ربات ها و عنکبوت ها گاهی اوقات می توانند مشکل ساز شوند و ترافیک ناخواسته ای را ایجاد کنند.

این نوع ترافیک ناخواسته می تواند منجر به موارد زیر شود:

مبهم بودن جایی که ترافیک از آنجا می آید.

گزارشات گیج کننده و درک آن سخت است.

انتساب نادرست در گوگل آنالیتیکس

افزایش هزینه های پهنای باندی که برای آن پرداخت می کنید.

سایر مزاحمت ها

ربات های خوب و ربات های بد وجود دارند.

ربات های خوب در پس زمینه اجرا می شوند و به ندرت به کاربر یا وب سایت دیگری حمله می کنند.

رباتهای بد امنیت یک وبسایت را میشکنند یا بهعنوان یک باتنت گسترده و در مقیاس بزرگ برای ارائه حملات DDOS علیه یک سازمان بزرگ استفاده میشوند (چیزی که یک ماشین نمیتواند آن را از بین ببرد).

در اینجا چیزی است که باید در مورد ربات ها بدانید و چگونه از خزیدن ربات های بد در سایت خود جلوگیری کنید.

ربات چیست؟

نگاه کردن به اینکه دقیقاً یک ربات چیست می تواند به شناسایی دلیل نیاز به مسدود کردن آن و جلوگیری از خزیدن آن در سایت کمک کند.

ربات، مخفف "ربات"، یک برنامه نرم افزاری است که برای تکرار یک کار خاص به طور مکرر طراحی شده است.

برای بسیاری از متخصصان سئو، استفاده از ربات ها همراه با مقیاس گذاری یک کمپین سئو است.

«مقیاسسازی» به این معنی است که تا حد امکان کار را خودکار میکنید تا سریعتر به نتایج بهتر برسید.

باورهای غلط رایج درباره ربات ها

ممکن است با این تصور اشتباه مواجه شده باشید که همه ربات ها شیطانی هستند و باید به صراحت از سایت شما منع شوند.

اما این نمی تواند دور از واقعیت باشد.

گوگل یک ربات است.

اگر گوگل را مسدود کنید، می توانید حدس بزنید چه اتفاقی برای رتبه بندی موتورهای جستجوی شما خواهد افتاد؟

برخی از رباتها میتوانند مخرب باشند، که برای ایجاد محتوای جعلی طراحی شدهاند یا خود را به عنوان وبسایتهای قانونی برای سرقت دادههای شما معرفی میکنند.

با این حال، ربات ها همیشه اسکریپت های مخربی نیستند که توسط بازیگران بد اجرا شوند.

برخی از آنها میتوانند ابزارهای خوبی باشند که به آسانتر کردن کار برای متخصصان سئو کمک میکنند، مانند خودکار کردن کارهای تکراری رایج یا جمعآوری اطلاعات مفید از موتورهای جستجو.

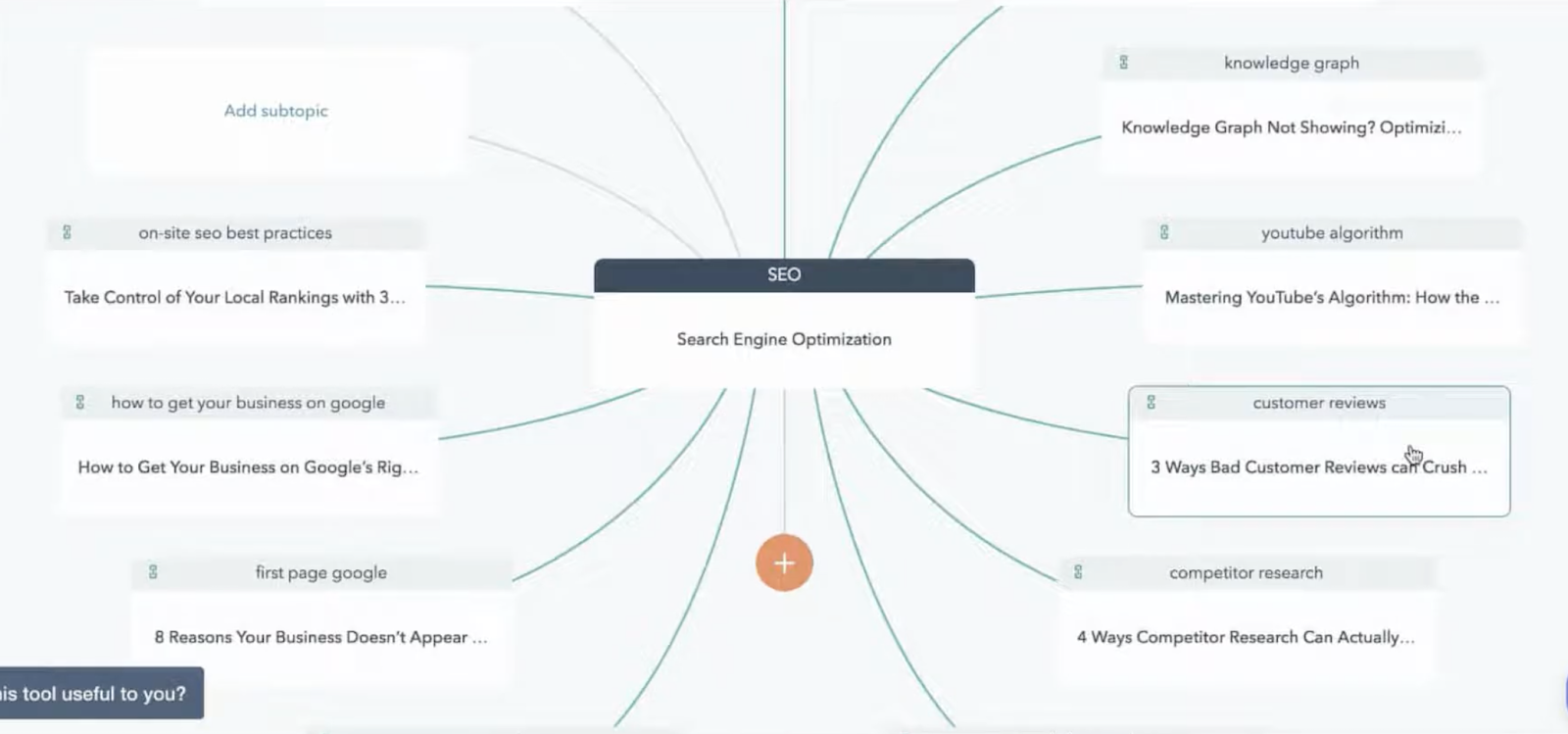

برخی از ربات های رایج که متخصصان سئو از آنها استفاده می کنند Semrush و Ahrefs هستند.

این رباتها دادههای مفیدی را از موتورهای جستجو جمعآوری میکنند، به متخصصان SEO کمک میکنند تا وظایف را خودکار و کامل کنند، و میتوانند به آسانتر کردن کار شما در انجام وظایف سئو کمک کنند.

چرا باید ربات ها را از خزیدن در سایت خود مسدود کنید؟

در حالی که ربات های خوب زیادی وجود دارند، ربات های بد نیز وجود دارند.

رباتهای بد میتوانند به سرقت دادههای خصوصی شما یا از بین بردن وبسایتی که غیر از آن کار میکند کمک کنند.

ما می خواهیم هر ربات بدی را که بتوانیم کشف کنیم مسدود کنیم.

کشف هر رباتی که ممکن است سایت شما را بخزد آسان نیست، اما با کمی جستجو، می توانید موارد مخربی را پیدا کنید که دیگر نمی خواهید از سایت خود بازدید کنید.

پس چرا باید از خزیدن ربات ها در وب سایت خود جلوگیری کنید؟

برخی از دلایل رایجی که ممکن است بخواهید رباتها را از خزیدن در سایت خود مسدود کنید، میتواند شامل موارد زیر باشد:

حفاظت از داده های ارزشمند شما

شاید متوجه شده باشید که یک افزونه تعدادی ربات های مخرب را جذب می کند که می خواهند داده های ارزشمند مصرف کننده شما را بدزدند.

یا متوجه شدید که یک ربات از یک آسیب پذیری امنیتی برای اضافه کردن لینک های بد در سراسر سایت شما استفاده کرده است.

یا، شخصی سعی می کند فرم تماس شما را با یک ربات اسپم کند.

اینجاست که باید اقدامات خاصی را انجام دهید تا از اطلاعات ارزشمند خود در برابر به خطر افتادن یک ربات محافظت کنید.

بیش از حد پهنای باند

اگر هجوم ترافیک رباتها را دریافت کنید، این احتمال وجود دارد که پهنای باند شما نیز سر به فلک بکشد و منجر به هزینههای بیش از حد پیشبینینشده و هزینههایی شود که ترجیح میدهید نداشته باشید.

شما کاملاً می خواهید ربات های متخلف را از خزیدن در سایت خود در این موارد مسدود کنید.

شما نمیخواهید شرایطی را داشته باشید که در آن هزاران دلار برای پهنای باندی که شایسته آن نیستید بپردازید.

پهنای باند چیست؟

پهنای باند انتقال داده از سرور شما به سمت مشتری (مرورگر وب) است.

هر بار که داده ها از طریق یک اتصال ارسال می شوند، شما از پهنای باند استفاده می کنید.

وقتی رباتها به سایت شما دسترسی پیدا میکنند و پهنای باندتان را هدر میدهید، میتوانید هزینههای بیش از حدی را که بیش از پهنای باند اختصاص داده شده ماهیانهتان است متحمل شوید.

هنگام ثبت نام برای بسته میزبانی خود، باید حداقل اطلاعات دقیقی از میزبان خود به شما داده می شد.

محدود کردن رفتار بد

اگر یک ربات مخرب به نحوی شروع به هدف قرار دادن سایت شما کرد، مناسب است اقداماتی برای کنترل آن انجام دهید.

برای مثال، میخواهید مطمئن شوید که این ربات نمیتواند به فرمهای تماس شما دسترسی داشته باشد. می خواهید مطمئن شوید که ربات نمی تواند به سایت شما دسترسی داشته باشد.

قبل از اینکه ربات بتواند حیاتی ترین فایل های شما را به خطر بیندازد این کار را انجام دهید.

با اطمینان از قفل و ایمن بودن سایت شما، میتوانید این رباتها را مسدود کنید تا آسیب زیادی وارد نکنند.

چگونه ربات ها را از سایت خود به طور موثر مسدود کنید

شما می توانید از دو روش برای مسدود کردن موثر ربات ها از سایت خود استفاده کنید.

اولین مورد از طریق robots.txt است.

این فایلی است که در ریشه وب سرور شما قرار دارد. معمولاً ممکن است به طور پیشفرض یکی نداشته باشید و باید یکی را ایجاد کنید.

اینها چند ربات بسیار کاربردی هستند.

کدهای txt که می توانید برای مسدود کردن اکثر عنکبوت ها و ربات ها از سایت خود استفاده کنید:

Googlebot را از سرور خود منع کنید

اگر به دلایلی میخواهید اصلاً Googlebot خزیدن سرور خود را متوقف کنید، کد زیر کدی است که استفاده میکنید:

عامل کاربر: Googlebot

غیر مجاز:

شما فقط می خواهید از این کد برای جلوگیری از ایندکس شدن سایت خود استفاده کنید.

از این به دلخواه استفاده نکنید!

دلیل خاصی برای اطمینان از اینکه اصلاً نمی خواهید ربات ها در سایت شما بخزند، داشته باشید.

به عنوان مثال، یک مشکل رایج این است که می خواهید سایت مرحله بندی خود را از فهرست خارج کنید.

شما نمی خواهید گوگل در سایت استیجینگ و سایت واقعی شما بخزد زیرا محتوای خود را دو برابر می کنید و در نتیجه مشکلات محتوای تکراری ایجاد می کنید.

همه ربات ها را از سرور خود غیرمجاز می کند

اگر می خواهید از خزیدن همه ربات ها در سایت خود جلوگیری کنید، کد زیر همان کدی است که می خواهید استفاده کنید:

عامل کاربر: *

غیر مجاز:

این کدی است که همه رباتها را مجاز نمیداند. نمونه سایت صحنه سازی ما را از بالا به یاد دارید؟

شاید بخواهید قبل از استقرار کامل سایت خود در همه ربات ها، سایت مرحله بندی را از همه ربات ها حذف کنید.

یا شاید بخواهید قبل از راه اندازی سایت خود در جهان، برای مدتی خصوصی نگه دارید.

در هر صورت، این سایت شما را از چشمان کنجکاو پنهان می کند.

جلوگیری از خزیدن ربات ها در یک پوشه خاص

اگر به دلایلی می خواهید ربات ها را از خزیدن در پوشه خاصی که می خواهید تعیین کنید جلوگیری کنید، می توانید این کار را نیز انجام دهید.

کد زیر کدی است که استفاده می کنید:

عامل کاربر: *

غیر مجاز: folder-name

دلایل زیادی وجود دارد که کسی بخواهد ربات ها را از یک پوشه حذف کند. شاید بخواهید مطمئن شوید که محتوای خاصی در سایت شما ایندکس نشده است.

یا شاید آن پوشه خاص باعث بروز انواع خاصی از مشکلات محتوای تکراری شود و شما بخواهید آن را به طور کامل از خزیدن حذف کنید.

در هر صورت، این به شما در انجام آن کمک می کند.

اشتباهات رایج با Robots.txt

چندین اشتباه وجود دارد که متخصصان سئو با robots.txt مرتکب می شوند. مهمترین اشتباهات رایج عبارتند از:

استفاده از هر دو Disallow در robots.txt و noindex.

با استفاده از اسلش رو به جلو (همه پوشه ها از ریشه به پایین هستند)، زمانی که منظور شما واقعاً یک URL خاص است.

مسیر صحیح را شامل نمی شود.

فایل robots.txt شما را آزمایش نمی کند.

عدم دانستن نام صحیح کاربر-عاملی که می خواهید مسدود کنید.

با استفاده از هر دو Disallow در Robots.txt و Noindex در صفحه

جان مولر از گوگل اعلام کرده است که نباید از هر دو Disallow در robots.txt و noindex در خود صفحه استفاده کنید.

اگر هر دو را انجام دهید، Google نمی تواند صفحه را برای دیدن noindex بخزد، بنابراین به طور بالقوه همچنان می تواند صفحه را ایندکس کند.

به همین دلیل است که شما باید فقط از یکی یا دیگری استفاده کنید و نه از هر دو.

با استفاده از اسلش رو به جلو وقتی منظور شما واقعاً یک URL خاص است

اسلش رو به جلو بعد از Disallow به معنای «از این پوشه ریشه به پایین، به طور کامل و به طور کامل برای ابدیت» است.

هر صفحه در سایت شما برای همیشه مسدود می شود تا زمانی که آن را تغییر دهید.

یکی از رایجترین مسائلی که در ممیزی وبسایت پیدا میکنم این است که شخصی به طور تصادفی یک اسلش رو به جلو به «عدم اجازه:» اضافه کرده و Google را از خزیدن کل سایت خود مسدود کرده است.google

مسیر صحیح را شامل نمی شود

متوجه هستیم. گاهی اوقات کدنویسی robots.txt می تواند کار سختی باشد.

در ابتدا نمیتوانستید مسیر دقیق را به خاطر بسپارید، بنابراین فایل را مرور کرده و آن را بالگذاری کردید.

مشکل این است که این مسیرهای مشابه همگی منجر به 404 می شوند زیرا یک کاراکتر خاموش هستند.

به همین دلیل مهم است که همیشه مسیرهایی را که در URL های خاص استفاده می کنید دوباره بررسی کنید.

شما نمی خواهید خطر اضافه کردن URL به robots.txt را داشته باشید که در robots.txt کار نمی کند.

نام صحیح User-Agent را نمی داند

اگر می خواهید یک کاربر-عامل خاص را مسدود کنید اما نام آن عامل کاربر را نمی دانید، این یک مشکل است.

به جای استفاده از نامی که فکر می کنید به خاطر دارید، کمی تحقیق کنید و نام دقیق کاربر-عامل مورد نیاز خود را بیابید.

اگر میخواهید رباتهای خاصی را مسدود کنید، آن نام در تلاشهای شما بسیار مهم میشود.

چرا دیگر ربات ها و عنکبوت ها را مسدود می کنید؟

دلایل دیگری نیز وجود دارد که متخصصان سئو میخواهند رباتها را از خزیدن در سایت خود مسدود کنند.

شاید آنها عمیقاً در PBN های کلاه خاکستری (یا کلاه سیاه) هستند و می خواهند شبکه وبلاگ خصوصی خود را از چشمان کنجکاو (به ویژه رقبای خود) پنهان کنند.

آنها می توانند این کار را با استفاده از robots.txt برای مسدود کردن ربات های رایجی که متخصصان سئو برای ارزیابی رقابت خود استفاده می کنند، انجام دهند.

به عنوان مثال Semrush و Ahrefs.

اگر میخواهید Ahrefs را مسدود کنید، این کد برای انجام این کار است:

عامل کاربر: AhrefsBot

غیر مجاز:

این کار AhrefsBot را از خزیدن کل سایت شما مسدود می کند.

اگر می خواهید Semrush را مسدود کنید، این کد برای انجام این کار است.

دستورالعمل های دیگری نیز در اینجا وجود دارد.

خطوط کد زیادی برای اضافه کردن وجود دارد، بنابراین هنگام اضافه کردن آنها مراقب باشید:

برای جلوگیری از خزیدن SemrushBot در سایت خود به دلیل سئو و مسائل فنی مختلف:

عامل کاربر: SiteAuditBot

غیر مجاز:

برای جلوگیری از خزیدن SemrushBot در سایت خود برای ابزار حسابرسی بک لینک:

عامل کاربر: SemrushBot-BA

غیر مجاز:

برای جلوگیری از خزیدن SemrushBot در سایت شما برای ابزار On Page SEO Checker و ابزارهای مشابه:

عامل کاربر: SemrushBot-SI

غیر مجاز:

برای مسدود کردن SemrushBot از بررسی URL های سایت خود برای ابزار SWA:

عامل کاربر: SemrushBot-SWA

غیر مجاز:

برای جلوگیری از خزیدن SemrushBot در سایت شما برای ابزارهای Content Analyzer و Post Tracking:

عامل کاربر: SemrushBot-CT

غیر مجاز:

برای جلوگیری از خزیدن SemrushBot در سایت شما برای نظارت بر برند:

عامل کاربر: SemrushBot-BM

غیر مجاز:

برای جلوگیری از خزیدن SplitSignalBot در سایت خود برای ابزار SplitSignal:

عامل کاربر: SplitSignalBot

غیر مجاز:

برای جلوگیری از خزیدن SemrushBot-COUB در سایت خود برای ابزار Content Outline Builder:

عامل کاربر: SemrushBot-COUB

غیر مجاز:

با استفاده از فایل HTACCESS خود برای مسدود کردن ربات ها

اگر از یک وب سرور APACHE استفاده می کنید، می توانید از فایل htaccess سایت خود برای مسدود کردن ربات های خاص استفاده کنید.

به عنوان مثال، در اینجا نحوه استفاده از کد در htaccess برای مسدود کردن ahrefsbot آمده است.

لطفا توجه داشته باشید: مراقب این کد باشید.

اگر نمی دانید چه کاری انجام می دهید، می توانید سرور خود را پایین بیاورید.

ما فقط این کد را در اینجا برای اهداف مثال ارائه می دهیم.

اطمینان حاصل کنید که قبل از افزودن آن به سرور تولید، تحقیق و تمرین خود را به تنهایی انجام دهید.

سفارش اجازه، رد کنید

انکار از 51.222.152.133

انکار از 54.36.148.1

رد کنید از 195.154.122

اجازه از همه

برای اینکه این کار به درستی کار کند، مطمئن شوید که تمام محدوده های IP فهرست شده در این مقاله در وبلاگ Ahrefs را مسدود کرده اید.

اگر می خواهید یک معرفی جامع برای .htaccess داشته باشید، به این آموزش در Apache.org نگاه نکنید.

اگر برای استفاده از فایل htaccess خود برای مسدود کردن انواع خاصی از ربات ها به کمک نیاز دارید، می توانید آموزش را در اینجا دنبال کنید.

مسدود کردن رباتها و عنکبوتها میتواند نیاز به کار داشته باشد

اما در نهایت ارزشش را دارد.

با اطمینان از اینکه رباتها و عنکبوتها را از خزیدن در سایت خود مسدود میکنید، مانند دیگران در دام نمیافتید.

با دانستن اینکه سایت شما در برابر برخی فرآیندهای خودکار مصون است، می توانید راحت باشید.

زمانی که بتوانید این رباتهای خاص را کنترل کنید، کارها را برای شما، متخصص سئو، بسیار بهتر میکند.

اگر مجبور هستید، همیشه مطمئن شوید که رباتها و عنکبوتهای مورد نیاز را از خزیدن در سایت شما مسدود کنید.

این منجر به افزایش امنیت، شهرت کلی آنلاین بهتر و سایت بسیار بهتری خواهد شد که در سال های آینده وجود خواهد داشت.

آموزش سئو...